- 发布日期:2025-01-09 12:13 点击次数:129

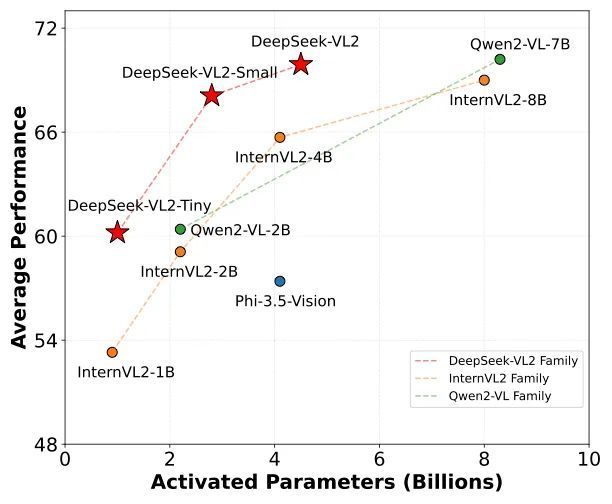

IT之家 12 月 14 日音信,DeepSeek 官方公众号昨日(12 月 13 日)发布博文,晓谕开源 DeepSeek-VL2 模子,在各项评测野心上均得到了极具上风的成绩,官方称其视觉模子慎重迈入羼杂众人模子(Mixture of Experts,简称 MoE)时间。

IT之家征引官方新闻稿,附上 DeepSeek-VL2 亮点如下:

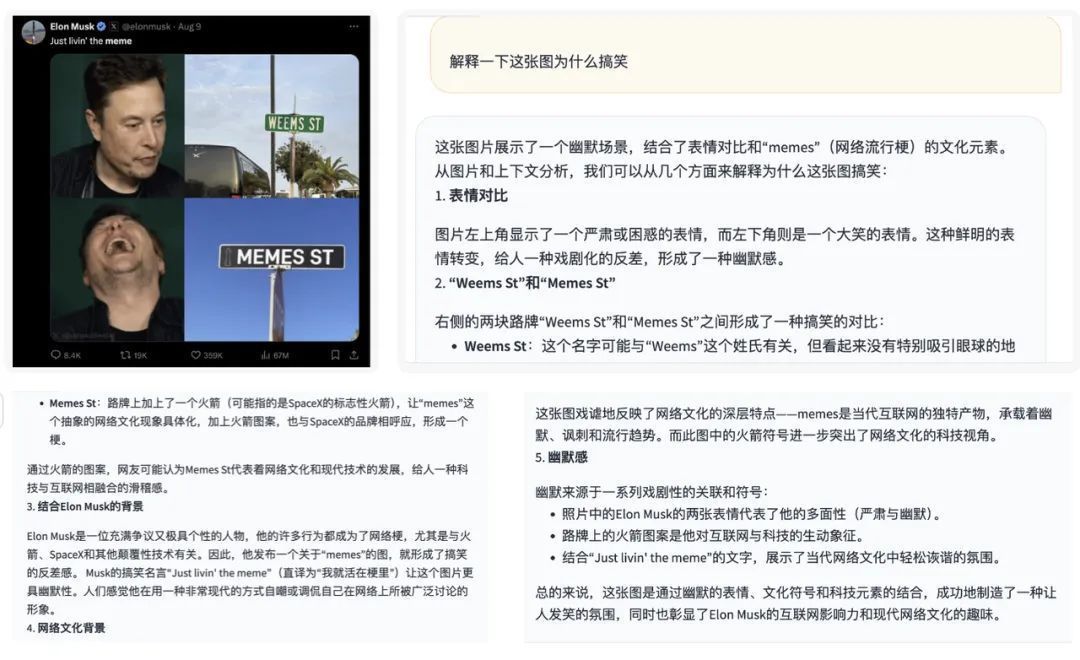

数据:比一代 DeepSeek-VL 多一倍优质锻真金不怕火数据,引入梗图瓦解、视觉定位、视觉故事生成等新时期

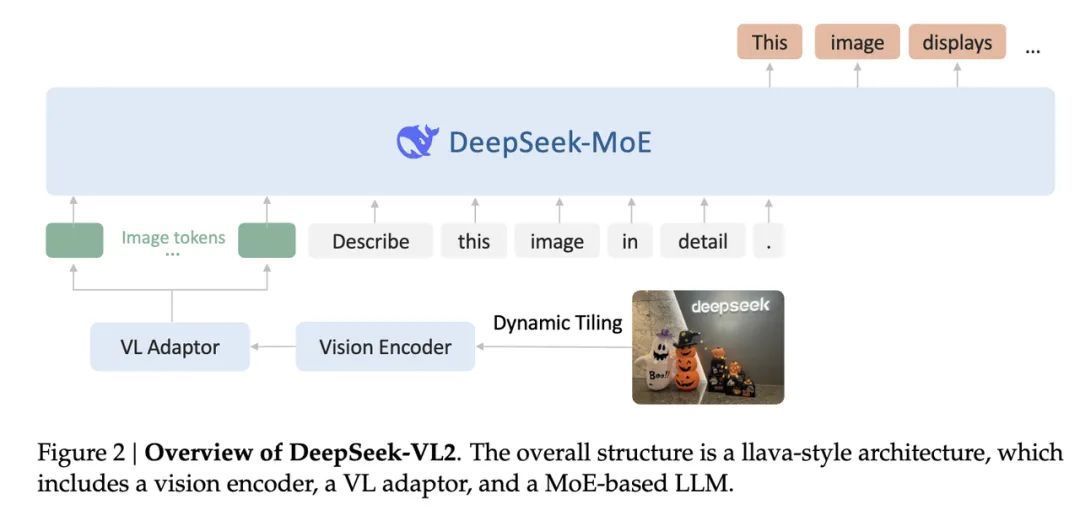

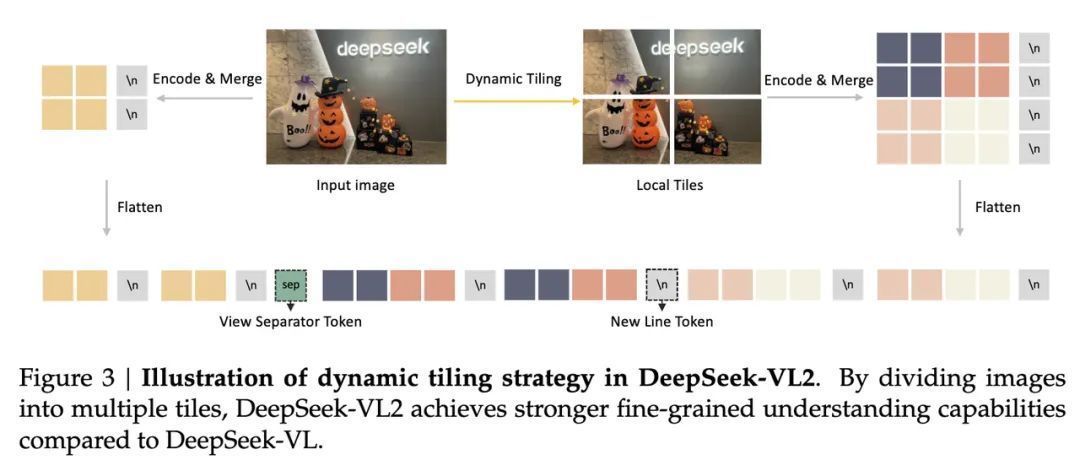

架构:视觉部分使用切图战术复旧动态分辩率图像,讲话部分接收 MoE 架构低资本高性能

锻真金不怕火:接收 DeepSeek-VL 的三阶段锻真金不怕火过程,同期通过负载平衡适配图像切片数目不定的贫瘠,对图像和文本数据使用不同活水并行战术,对 MoE 讲话模子引入众人并行,完毕高效锻真金不怕火

DeepSeek-VL2 模子复旧动态分辩率,仅使用一个 SigLIP-SO400M 看成图像编码器,通过将图像切分为多张子图和一张全局缩略图来完毕动态分辩率图像复旧。这一战术让 DeepSeek-VL2 最多复旧 1152x1152 的分辩率和 1:9 或 9:1 的顶点长宽比,适配更多愚弄场景。

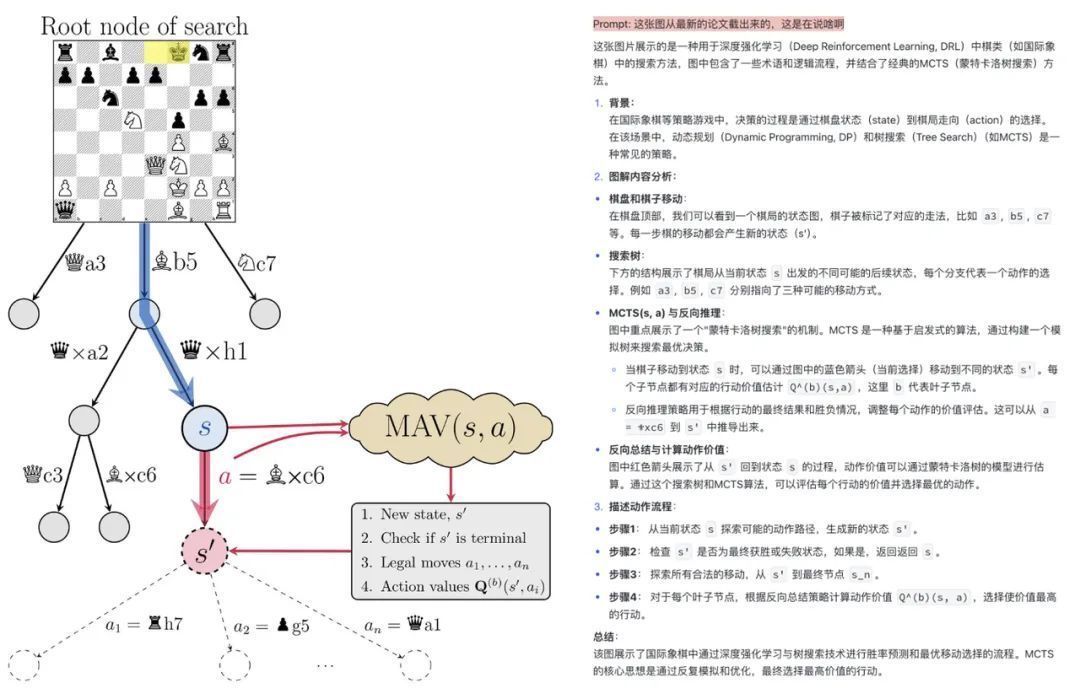

DeepSeek-VL2 模子还收获于更多科研文档数据的学习,不错自负瓦解多样科研图表,并通过 Plot2Code,阐述图像生成 Python 代码。

模子和论文均已发布:

模子下载:https://huggingface.co/deepseek-ai

GitHub 主页:https://github.com/ deepseek-ai/DeepSeek-VL2

- 微软欲打造AI智能体生态 哄骗侧最精采场景已具雏形2024-11-25

- 好意思国要在AI赛谈上“火力全开”?国会收到建议:运行“曼哈顿式霸术”2024-11-25

- 探讨“国外西席4.0期间“ RAISE2024第七届亚洲国外学校大会在蓉开幕2024-11-21

- AI会问问题采访了,媒体东说念主会休闲吗?2024-10-27

- Canalys:预测2025年AI PC将增长204% 中东地区倏地电子市集迎深广机遇2024-10-18

- 交大女硕士抢先国产自主调动,用AI赋能半导体量测2024-10-18